La Fédération de Russie présente une lettre à l’Assemblée générale des Nations Unies contenant un projet de Convention des Nations Unies sur la coopération dans la lutte contre la cybercriminalité, destinée à être distribuée aux États membres.

Novembre 2019

Une résolution, sponsorisée par la Russie – avec la Biélorussie, le Cambodge, la Chine, l’Iran, le Myanmar, le Nicaragua, la Syrie et le Venezuela – visant à mettre en place une convention internationale pour lutter contre la cybercriminalité passe devant l’Assemblée générale des Nations Unies. La résolution a rencontré l’opposition des États-Unis, de l’UE et d’autres nations. Les organisations de défense des droits de l’homme, dont l’Association pour le progrès des communications et l’EFF, ont exhorté l’Assemblée générale à voter contre la résolution, craignant qu’elle « ne puisse porter atteinte à l’utilisation d’Internet pour exercer les droits de l’homme et faciliter le développement social et économique ».

Décembre 2019

L’Assemblée générale des Nations Unies adopte une résolution pour créer un Comité ad hoc (AHC) chargé de rédiger une convention des Nations Unies « sur la lutte contre l’utilisation des technologies de l’information et des communications à des fins criminelles ». La participation au CAH est ouverte à tous les États membres du monde, ainsi qu’aux observateurs des États non-membres (comme l’UE et le Conseil de l’Europe), à la société civile et aux organisations non gouvernementales (ONG) à des degrés divers. L’Office des Nations Unies contre la drogue et le crime (UNODC), par l’intermédiaire du Service de la criminalité organisée et du trafic illicite, de la Division des traités, assure le secrétariat du Comité spécial. Cependant, le calendrier de cet effort était controversé, car une autre résolution de l’Assemblée générale des Nations Unies avait soulevé des inquiétudes quant au fait que les lois sur la cybercriminalité « sont dans certains cas utilisées à mauvais escient pour cibler les défenseurs des droits de l’homme ou ont entravé leur travail et mis en danger leur sécurité d’une manière contraire au droit international ».

Août 2020

L’AHC reporte sa première réunion d’organisation à New York à 2021 en raison du COVID-19.

Janvier 2021

Human Rights Watch déclenche les alarmes sur le fait que les États membres de l’ONU entament le processus d’un traité sur la cybercriminalité dont « les champions sont certains des gouvernements les plus répressifs du monde… l’initiative soulève de graves préoccupations en matière de droits humains ».

Mai 2021

L’AHC convoque la session d’organisation inaugurale, avec des représentants de plus de 160 pays convenant d’un plan et des modalités des négociations. L’AHC appelle à au moins six sessions de négociation de 10 jours chacune à partir de 2022, qui se tiendront à New York et à Vienne. L’Assemblée générale adopte la proposition parmi des plaintes du Royaume-Uni et d’autres pays selon lesquelles les États membres n’ont pas été consultés sur le texte final et le processus de rédaction manquait d’inclusivité.

De nombreux orateurs avaient des objections similaires, dont plusieurs divergeaient sur la structure décisionnelle de l’AHC. Fixant les conditions des négociations, le Brésil a introduit un amendement exigeant que le comité obtienne l’approbation d’une majorité des deux tiers des représentants, plutôt qu’une majorité simple favorisée par la Russie, « avant laquelle le président informera le comité que tout effort pour parvenir à un accord par le consensus a été épuisé ». L’amendement a été approuvé par 88 voix contre 42, avec 32 abstentions. Dans une décision emblématique distincte visant à plus de transparence et d’inclusion, les États membres ont approuvé une liste de représentants des institutions universitaires, du secteur privé et des ONG concernés, notamment EFF, Eticas, Red en Defensa de los Derechos Digitales, Global Partenaires Digital, Hiperderecho et Instituto Panameño de Derecho y Nuevas Tecnologías, entre autres. Les ONG dotées du statut consultatif auprès de l’ECOSOC peuvent également y assister, telles que Privacy International, Human Rights Watch et Derechos Digitales.

Décembre 2021

Avant la première session de négociation de l’AHC, EFF, Human Rights Watch et plus de 100 organisations et universitaires travaillant dans 56 pays, régions ou dans le monde, exhortent les membres de l’AHC dans une lettre à s’assurer que les protections des droits de l’homme sont intégrées dans le produit final. Le projet de traité des Nations Unies sur la cybercriminalité est présenté au moment même où les mécanismes des droits de l’homme des Nations Unies sonnent l’alarme sur l’abus des lois sur la cybercriminalité dans le monde, indique la lettre. Les groupes soulignent : « Il est essentiel de limiter la portée de toute convention sur la cybercriminalité pour protéger les droits de l’homme ».

Janvier 2022

Le Comité pour la protection des journalistes (CPJ) avertit que le projet de traité de l’ONU sur la cybercriminalité pourrait mettre en danger les journalistes en donnant de nouveaux outils aux autorités qui cherchent à punir ceux qui rapportent l’actualité. « De nombreuses autorités à travers le monde invoquent déjà les lois sur la cybercriminalité ou la cybersécurité pour punir les journalistes – non pas pour avoir secrètement piraté des réseaux ou des systèmes, mais pour avoir ouvertement utilisé les leurs pour faire connaître des actes répréhensibles », a déclaré le CPJ dans un communiqué.

Février 2022

La première session officielle de 10 jours de l’AHC se réalise à New York et les négociations commencent. L’EFF et les ONG de défense des droits de l’homme participent à distance et en personne, et soulignent l’importance de la protection des droits de l’homme dans tout projet de traité des Nations Unies sur la cybercriminalité. La crise en Ukraine occupe une place importante dans les pourparlers, qui coïncident avec les rares sessions d’urgence de l’Assemblée générale et du Conseil de sécurité de l’ONU, où les membres ont condamné l’invasion de l’Ukraine par la Russie.

Une feuille de route et un mode de travail sont adoptés, abordant les objectifs, la portée et la structure de la convention. Il est important de noter que l’approbation a été donnée pour la tenue de consultations intersessions entre les sessions de négociation du CAH afin de solliciter la contribution d’un large éventail de parties prenantes, y compris des organisations de défense des droits de l’homme et du numérique, sur la formation du projet de traité.

Les soumissions des États membres à la première session démontrent un manque prononcé de consensus sur ce qui constitue un « cybercrime » et sur la portée du traité. Des États tels que le Brésil, la République dominicaine, l’Union européenne (UE), le Liechtenstein, la Norvège, la Suisse, le Royaume-Uni et les États-Unis plaident pour une approche plus étroite de la criminalité, mettant en garde contre l’utilisation de ce traité pour imposer des contrôles plus larges sur Internet. Certains États ont également appelé à l’inclusion des délits liés au contenu, tels que l’incitation au terrorisme (Chine, Russie), la désinformation (Chine, Indonésie) et la violation du droit d’auteur (Indonésie, Liechtenstein, Mexique, Norvège, Russie, États-Unis).

Mars 2022

La première consultation intersessions avec des organisations de défense des droits et d’autres multipartites s’est tenue à Vienne. Lors d’une table ronde devant les États membres de l’ONU, ARTICLE19 exprime ses inquiétudes quant à la nécessité d’une convention sur la cybercriminalité et les risques que la convention perpétue les abus existants des lois sur la cybercriminalité. AccessNow appelle à éviter les approches trop larges de la criminalisation. De la salle, l’EFF souligne l’importance de donner la priorité à la protection des droits de l’homme, car ne pas le faire peut avoir des conséquences désastreuses, et signale que le champ d’application de la convention devrait être limité uniquement aux affaires pénales.

Avril 2022

Human Rights Watch, EFF et Privacy International attirent l’attention sur le changement de dynamique géopolitique qui a conduit de nombreux États initialement opposés au traité (près d’un tiers des membres de l’ONU) à participer activement et même à assumer des rôles de leadership dans les négociations.

Mai 2022

Deuxième session de négociation tenue à Vienne. L’AHC sollicite les contributions d’un large éventail de parties prenantes sur le texte proposé pour les chapitres sur la criminalisation, les dispositions générales, les mesures procédurales et l’application de la loi du traité. EFF, Privacy International et Human Rights Watch soumettent une déclaration à l’AHC soulignant l’importance de n’inclure que les cybercrimes de base dans le traité et d’éviter des dispositions trop générales. Lors d’une déclaration orale devant les États membres de l’ONU, EFF, Privacy International et Human Rights Watch ont réitéré la nécessité de se concentrer sur les crimes qui ciblent spécifiquement les technologies de l’information et de la communication (TIC). L’EFF a défini les cybercrimes de base comme des infractions dans lesquelles les TIC servent à la fois d’objets directs et d’instruments des crimes. Les groupes demandent également que tout futur traité garantisse que les dispositions relatives à l’accès illégal, illégal ou non autorisé aux TIC ne criminalisent pas la recherche sur la sécurité, le travail des lanceurs d’alerte et d’autres utilisations nouvelles et interopérables de la technologie qui profitent en fin de compte au public. La session est suivie par des représentants de 143 États membres de l’ONU.

June 2022

La deuxième consultation intersessions avec plusieurs parties prenantes a lieu à Vienne. Avant la réunion, l’EFF exprime son inquiétude par le fait que certains États membres de l’ONU proposent des dispositions ambiguës pour lutter contre les discours de haine, l’extrémisme ou le terrorisme, qui pourraient considérablement compromettre la liberté d’expression. Par exemple, la Jordanie propose d’utiliser le projet de traité pour criminaliser “les discours de haine ou les actions liées à l’insulte aux religions ou aux États utilisant des réseaux d’information ou des sites Web”, tandis que l’Égypte appelle à interdire la “propagation des conflits, de la sédition, de la haine ou du racisme”. La Russie, en collaboration avec la Biélorussie, le Burundi, la Chine, le Nicaragua et le Tadjikistan, a proposé de criminaliser une série d’infractions liées au contenu, y compris des actes liés à l’extrémisme vaguement définis. La terminologie ambiguë utilisée pourrait potentiellement conduire à des interprétations trop larges, dans de nombreux cas, ne respectant pas les normes de la liberté d’expression en matière de droits de l’homme.

Le Haut-Commissariat des Nations Unies aux droits de l’homme (HCDH en français, OHCHR en anglais) a souligné que tout futur traité sur la cybercriminalité ne devrait pas inclure d’infractions fondées sur le contenu de l’expression en ligne, déclarant : « Les lois sur la cybercriminalité ont été utilisées pour imposer des restrictions trop larges à la liberté d’expression en criminalisant divers contenus en ligne tels que l’extrémisme ou le discours de haine ». La nécessité d’imposer l’adoption universelle de telles infractions liées au contenu, qui manquent de consensus parmi les États membres et ont été utilisées pour poursuivre des militants, est remise en question. Ces infractions incluent également la criminalisation de la distribution de matériel qui « incite à des actes illégaux motivés par la haine politique, idéologique, sociale, raciale, ethnique ou religieuse ». En outre, la même proposition oblige chaque État partie à légiférer contre l’humiliation d’individus ou de groupes par le biais des TIC sur la base de la race, de l’ethnie, de la langue, de l’origine ou de l’appartenance religieuse. L’adoption de ces dispositions reviendrait à criminaliser la parole protégée.

Les propositions de l‘Inde concernant les infractions de soutien au terrorisme sont tout aussi problématiques, car elles manquent d’une définition convenue à l’échelle mondiale. Le terme “terrorisme” a souvent été utilisé à mauvais escient pour cibler des militants critiques à l’égard de leurs gouvernements, soulignant l’absence de consensus mondial sur ce terme. Par conséquent, des dispositions aussi ambiguës risquent d’étouffer la dissidence politique et de menacer la liberté d’expression.

Juillet 2022

La société civile envoie une lettre au Comité ad hoc, demandant la réouverture du processus d’accréditation pour les acteurs qui ont manqué la période d’enregistrement initiale, qui a été refusée.

Août 2022

Troisième session de négociation tenue à New York, au cours de laquelle des organisations de défense des droits de l’homme, dont l’EFF, présentent des déclarations orales concernant les chapitres sur la coopération internationale, l’assistance technique et les mesures préventives. Avant les négociations, l’EFF a mis en relief que le chapitre sur la coopération internationale devait inclure un mécanisme de double incrimination et ne devrait pas avoir un champ d’application illimité qui s’applique à tous les types de crimes. L’EFF a également exhorté les gouvernements à investir davantage de ressources et de formation pour améliorer le fonctionnement des systèmes de traités d’entraide judiciaire (MLAT). La session est suivie par des représentants de 149 États membres de l’ONU.

Bien que la convention porte sur la cybercriminalité, certains États soutiennent qu’elle devrait constituer la base de la coopération internationale dans la collecte de preuves pour tout crime faisant l’objet d’une enquête. L’UE, par exemple, a proposé un langage de compromis, affirmant qu’elle reste ouverte au concept de coopération s’appliquant à la collecte de preuves non seulement dans les crimes graves, mais dans n’importe quel crime – une disposition de la Convention de Budapest – tant que de solides garanties en matière de droits de l’homme sont en place.

Les soumissions du Brésil et de la Russie suggèrent que la coopération pourrait inclure une assistance mutuelle pour les enquêtes et les poursuites dans les affaires “civiles et administratives” et d’autres enquêtes sur des “actes illégaux” non définis.

Novembre 2022

Troisième consultation intersessions avec plusieurs parties prenantes tenue à Vienne. L’EFF et le Haut-Commissariat aux droits de l’homme (HCDH) sont invités à présenter leurs points de vue aux États membres. L’EFF continue de plaider en faveur d’un traité plus ciblé qui comprend de solides garanties pour la protection des droits de l’homme afin de prévenir les abus potentiels à l’avenir. Le HCDH (OHCHR) a souligné que tout projet de traité des Nations Unies sur la cybercriminalité devrait faire référence aux lois internationales sur les droits de l’homme ou aux instruments et normes régionaux des droits de l’homme dans le préambule. Cela aiderait à guider les éléments, l’interprétation et l’application du Traité, en veillant à ce qu’il soit conforme aux principes des droits de l’homme universellement reconnus. La session a réuni des représentants de 149 États membres.

Après l’intersession, l’AHC publie le document de négociation consolidé (CND, Consolidated Negotiating Document), un projet de texte des dispositions de la convention proposée créé à partir des propositions des États membres. Le projet comporte trois chapitres, commençant par une déclaration d’intention et se terminant par des dispositions sur les questions de procédure et d’application de la loi. Le deuxième chapitre traite des mesures pénales à adopter au niveau national, et est divisé en 11 « clusters ». Les clusters traitent des infractions, telles que l’accès illégal à un système informatique et l’utilisation abusive d’appareils, et des procédures, telles que la collecte de données en temps réel et l’interception de données de contenu. Le texte comprend une longue liste de crimes qui interfèrent avec la liberté d’expression et ne respectent pas les restrictions autorisées à la liberté d’expression en vertu de l’article 19(3) du Pacte international relatif aux droits civils et politiques (PIDCP). En outre, l’Assemblée générale des Nations Unies a clairement indiqué que les États devraient éviter d’imposer des limites à diverses formes d’expression telles que la discussion des politiques gouvernementales, les débats politiques, les rapports sur les droits de l’homme et les activités gouvernementales et la corruption, les campagnes électorales, les manifestations pacifiques ou les activités politiques ; et l’expression d’opinions et de dissidences, de religions ou de convictions, y compris par des personnes appartenant à des minorités ou à des groupes vulnérables.

Décembre 2022

L’EFF et 10 autres organisations de la société civile écrivent à l’AHC, dans une lettre soutenue par des dizaines d’autres groupes et universitaires du monde entier, exprimant de vives inquiétudes quant au fait que le CDN « risque d’enfreindre le droit international des droits de l’homme ». La lettre recommande une série de révisions et de modifications à la CDN pour remédier aux dispositions troublantes qui pourraient amener les États membres à traiter divers types de discours, dont la plupart seraient pleinement protégés par le droit international des droits de l’homme, comme une infraction pénale. En outre, la lettre indique que les principales infractions de cybercriminalité dans le texte imposeraient certaines restrictions qui pourraient interférer avec les méthodes de travail essentielles des journalistes, des lanceurs d’alerte et des chercheurs en sécurité et doivent être révisées.

L’EFF et Privacy International soumettent leurs observations demandant aux États membres d’inclure des freins et contrepoids solides dans le projet de traité afin de l’aligner sur la jurisprudence existante des tribunaux et organes des droits de l’homme. Par exemple, le projet de texte devrait intégrer les principes de légalité, de nécessité et de proportionnalité, et exiger une autorisation indépendante préalable (de préférence judiciaire), un contrôle indépendant a posteriori et le droit à un recours effectif. L’EFF et Privacy International demandent également des garanties garantissant que tous les pouvoirs d’enquête énumérés dans la Convention soient exercés de manière à ne pas compromettre la sécurité des communications et des services numériques.

Janvier 2023

La quatrième session de négociation du Comité ad hoc (AHC) s’est tenue à Vienne, avec la participation de représentants de 149 États membres de l’ONU. Le comité discute de la CND. EFF, Derechos Digitales, R3D, Global Partners Digital et Access Now font des déclarations orales soulignant que parmi les caractéristiques les plus préoccupantes de la CND figure la liste longue et croissante d’infractions pénales proposées destinées à être incluses dans le projet de convention. La proposition de la Chine selon laquelle le traité criminalise la “diffusion de fausses informations” dans la dernière version de la CND, publiée le 21 janvier, alimente encore les inquiétudes.

Au cours des négociations, une grande partie de la discussion sur le chapitre sur la criminalisation s’est concentrée sur les infractions liées au contenu dans les groupes (clusters) 5 et 7. Le président de l’AHC a adopté une approche proactive pour aborder les questions les plus litigieuses, menant les discussions en dehors de la plénière formelle et dans des groupes informels qui étaient fermés aux acteurs concernés des ONG. Le matériel le plus controversé se trouve dans les groupes 3, 6, 8 et 9. Les infractions proposées dans ces groupes couvrent un large éventail de comportements pour lesquels il n’y a pas de consensus unifié sur la façon dont ils devraient être définis, allant de « violation du droit d’auteur », « encouragement ou la coercition au suicide », et « l’incitation à la subversion », au « terrorisme », à « l’extrémisme » et au « trafic de drogue », ainsi que l’interception de contenu, l’interception en temps réel et l’administration de preuves électroniques, entre autres. Le langage des propositions est vague, ce qui pourrait conduire à une interprétation et à une application excessives. Au cours des négociations, plusieurs pays, dont Singapour, la Malaisie et la Russie, cherchent à supprimer l’article 42, qui fournit des garanties essentielles en matière de droits humains contre les pouvoirs de surveillance.

Mars 2023

Quatrième consultation intersessions organisée avec de multiples parties prenantes à Vienne et en ligne, avec la participation de 61 États membres et États non-membres observateurs. Au cours d’une table ronde intitulée “Une coopération efficace et réactive et d’autres aspects du chapitre sur la coopération internationale”, un panéliste d’INTERPOL a remis en question l’efficacité des traités d’entraide judiciaire (MLAT), citant des processus bureaucratiques dans plusieurs juridictions et des contraintes de ressources. En réponse aux préoccupations d’INTERPOL, la société civile a émis des réserves sur son approche. Comme indiqué dans le principe 12 des Principes nécessaires et proportionnés, approuvés par plus de 400 ONG :

« Lorsque les États demandent une assistance à des fins répressives, le principe de la double incrimination devrait être appliqué. … Les États ne peuvent pas utiliser les processus d’entraide judiciaire et les demandes étrangères d’informations protégées pour contourner les restrictions légales nationales sur la surveillance des communications ».

INTERPOL soutient que la complexité de la conservation des enregistrements de communication détenus par des entreprises privées ou de la demande d’informations de base sur les abonnés, le trafic ou les données de contenu est encore compliquée parce que les pays détenant des données ont des normes de preuve différentes. Ces préoccupations ont été accueillies avec scepticisme. Lors de sessions précédentes, l’EFF a averti que de tels arguments pourraient présenter un « risque réel que, dans une tentative d’inciter tous les États à signer un projet de convention des Nations Unies sur la cybercriminalité, de mauvaises pratiques en matière de droits de l’homme soient prises en compte, entraînant une course vers le bas ».

Avril 2023 (programmé)

La cinquième session de négociation de l’AHC se tiendra à Vienne et en ligne. Les participants discuteront des chapitres du CND qui n’ont pas été abordés lors des sessions précédentes. Ces nouveaux chapitres couvrent le préambule, les dispositions sur la coopération internationale, les mesures préventives, l’assistance technique entre les États membres, le mécanisme de mise en œuvre et les dispositions finales du projet de convention internationale globale.

Juin 2023 (programmé)

Cinquième consultation intersessions avec de multiples parties prenantes qui se tiendra à Vienne.

Août 2023 (programmé)

La sixième session du CAH se tiendra à New York. Un avant-projet de texte de la convention est prévu.

Janvier – Février 2024 (dates précises à déterminer)

La session de clôture potentielle du CAH se tiendra à New York, qui comprendra la discussion, la finalisation et l’approbation du projet de texte de la convention. Le projet sera annexé pour examen et adoption par l’Assemblée générale des Nations Unies en 2024.

BY KAREN GULLO AND KATITZA RODRIGUEZ

Cet article a été publié en partenariat avec EFF

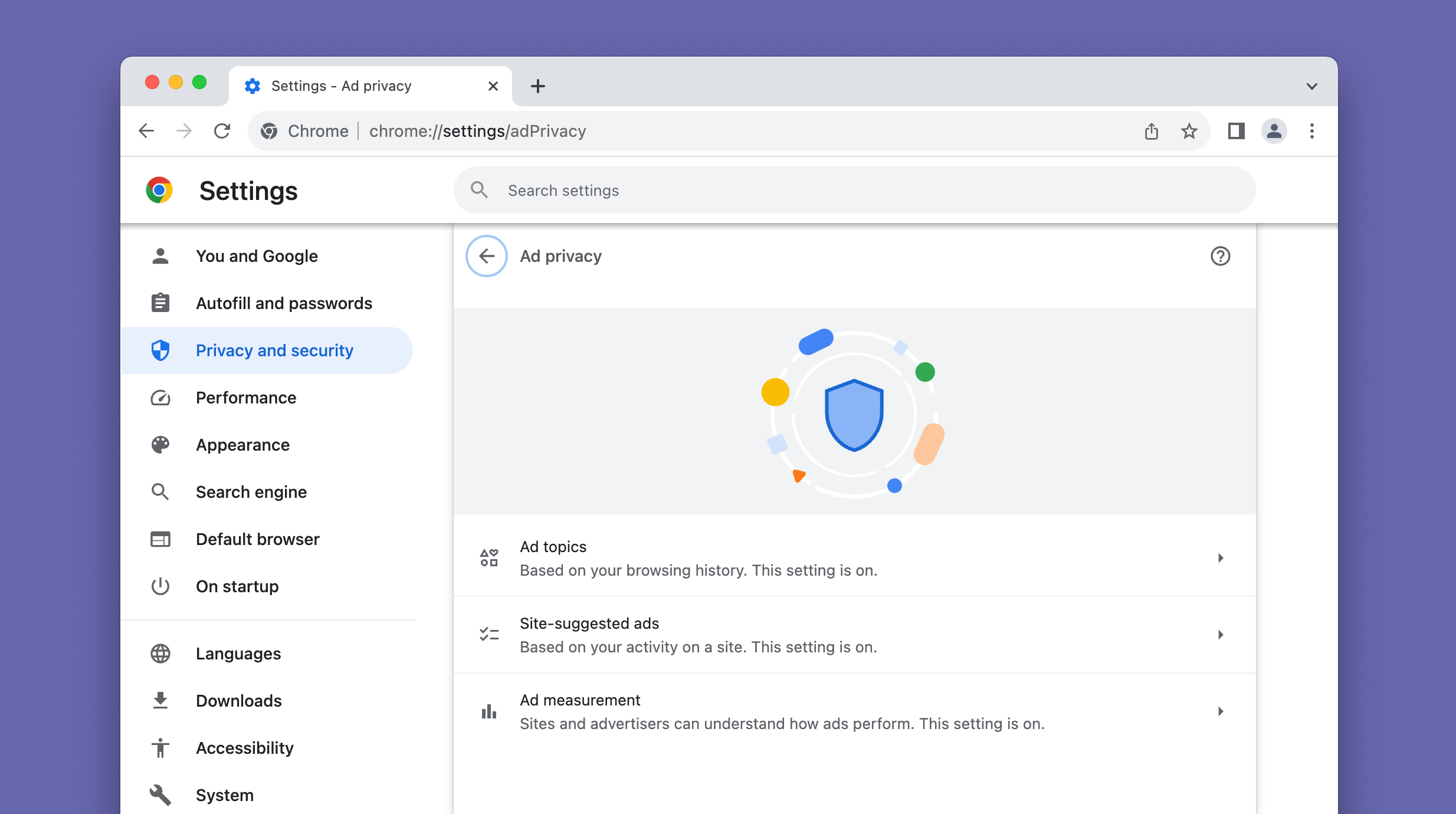

Selon la dernière mise à jour de Chrome, vous avez peut-être déjà reçu une fenêtre contextuelle vous demandant d’accepter la « Confidentialité améliorée des publicités dans Chrome ». Si vous venez de cliquer sur le gros bouton bleu indiquant « Compris » pour faire disparaître la fenêtre contextuelle, vous vous êtes inscrit. Mais vous pouvez toujours

Selon la dernière mise à jour de Chrome, vous avez peut-être déjà reçu une fenêtre contextuelle vous demandant d’accepter la « Confidentialité améliorée des publicités dans Chrome ». Si vous venez de cliquer sur le gros bouton bleu indiquant « Compris » pour faire disparaître la fenêtre contextuelle, vous vous êtes inscrit. Mais vous pouvez toujours